Google I/O 2021 での Google Cloud 関連リリース

Google Cloud Japan Team

※この投稿は米国時間 2021 年 5 月 25 日に、Google Cloud blog に投稿されたものの抄訳です。

先日 Google I/O 2021 が無事開催されました。今年の Google I/O はバーチャルで実施されましたが、215,000 人を超える登録者、235 回を超えるセッション、186,565 個の獲得バッジ、数十回のワークショップと AMA が見られ、勢いはまったく衰えませんでした。世界中の視聴者が、Android、WearOS、Flutter、TensorFlow を含む Google からの最新のリリースを知るために再び参加しました。デベロッパーは、最新のツール、API、構築に役立つ改善されたエクスペリエンスを学習することで、スキルを磨きに来ました。

Google Cloud は、新しい統合 AI プラットフォーム、豊富なコラボレーション エクスペリエンス、カーボン アウェア コンピューティングの飛躍的進歩など、AI、Google Workspace、サステナビリティに関する多数の主要なリリースを発表し、話題の中心となりました。このイベントに参加できず、クラウド関連の重要セッション一覧をご覧になりたい場合は、I/O のクラウド デベロッパー ガイドをご覧ください。ここでは I/O で Google Cloud から発表された内容の詳細についてご案内します。

Vertex AI

最も注目すべき Google Cloud のリリースの一つは、Vertex AI の一般提供でした。これは、企業が人工知能(AI)プラットフォームのデプロイと保守作業を迅速に行えるようにするマネージド統合機械学習(ML)プラットフォームです。Google Cloud はエンドツーエンドの ML ライフサイクルを提供しており、AI Platform と、AutoML Vision、Tables、Natural Language などの AutoML プロダクトで市場をリードしてきました。一方で AutoML でのトレーニングと AI Platform で行うカスタム トレーニングとの間でエクスペリエンスが分断されることは、ユーザーにとって望ましくないことを理解しています。

そこで、Vertex AI は、テスト、バージョニング、ML / AI モデルの本番環境へのデプロイについて、既存のサービスを単一のエクスペリエンスに統合します。AI Platform Training、AI Platform Prediction、AutoML Tables、AutoML Vision、AutoML Video Intelligence、AutoML Natural Language、Explainable AI、Data Labeling の新しいワークフロー(UI、API、SDK)を通じて、モデルをシームレスに管理してデプロイできます。こうした各サービスが、AI Platform(統合型)の進化形である Vertex AI の機能として利用可能になりました。

ML Ops にも対応

新しい分野である MLOps がコミュニティの間で急速に勢いを増している理由は、それが再現可能、テスト可能、進化可能な ML 搭載ソフトウェアを設計、構築、管理するためのエンドツーエンドの機械学習開発プロセスをもたらしていることです。Vertex AI には、次のような新しい MLOps 機能が含まれています。

Vertex Experiments - モデル選択を迅速化するための ML テストの追跡、分析、検出。

Vertex Vizier - モデルの予測精度を最大化するためにハイパーパラメータのための最適化された値を提供。

Vertex Pipelines - ML パイプラインのビルドと実行を合理化して、MLOps を簡素化。

Explainable AI - 予測にとっての各入力特徴の重要性を把握できるように、詳細なモデル評価指標と特徴属性を提供。

エンドツーエンドの ML ライフサイクル

Vertex AI は、ML ワークフローの次の工程の管理に使用できます。

データセットを定義してアップロードする。

AutoML を使用するか、さまざまなマシンタイプと GPU でカスタム トレーニングを使用して、データで ML モデルをトレーニングする。カスタムモデルのモデル評価を取得してハイパーパラメータを調整する。

カスタム ML モデル データセットの人間によるラベル付けをリクエストできるデータラベル付けジョブを使用する。

モデルをアップロードして Vertex AI に保存する。

トレーニング済みモデルをデプロイし、予測を提供するためのエンドポイントを取得する。

予測リクエストをエンドポイントに送信する。

エンドポイントで予測のトラフィック分割を指定する。

モデルとエンドポイントを管理する。

Vertex AI を操作する手段は以下のとおりです。

JupyterLab とディープ ラーニングがパッケージ済みのノートブック。

ML リソースを操作し、ロギングとモニタリングを利用するための UI である Google Cloud Console。

一連の言語のデベロッパー エクスペリエンスを最適化するための Cloud クライアント ライブラリ。または Dart などの他の言語を使用して Vertex AI API にアクセスするための Google API クライアント ライブラリ。

ジョブ、モデル、エンドポイント、予測を管理するための REST API。

単一のエクスペリエンスとインターフェースで AutoML を使用することも、カスタムモデルを作成することもでき、インフラストラクチャ、データ モデリング、UX、API レイヤーは共通化され、データ サイエンスと本番環境の間をすばやく移動することも可能です。ノートブック ベースの開発バージョンとホスト型クラウドの本番環境バージョンの両方が利用できます。ML の経験が浅いユーザーには AutoML の説明機能と自動プロビジョニング機能が役立ちます。また、経験を積むにつれて Vertex AI の残りの機能を活用し、制約の管理や独自のきめ細かい設定をすべて 1 か所から行うこともできます。

利用開始にあたっての参照リソース

まず GCP ポッドキャストをお聞きください。Google Cloud の AI 担当エグゼクティブが責任ある AI の取り組みと、Vertex AI を使用したより包括的で正確な ML プラクティスを実装する方法についてお話ししています。また、画像データのトレーニング、カスタム トレーニングの実施、構造化データの取り込みに関する Vertex AI チュートリアルのドキュメントをチェックし、Python、Java、Node.js などのコードサンプルを入手しましょう。さらに、6 月 10 日に g.co/appliedmlsummit で開催されるデジタルの Applied ML Summit に参加して、Vertex AI の技術チュートリアルと、主要なイノベーターや Kaggle Grandmasters との対話形式セッションをご覧ください。

Google Workspace

スマート キャンバス

Google Workspace は、スマート キャンバスを発表しました。これは新しいプロダクト エクスペリエンスで、Google Workspace のコラボレーションの次の進化を実現します。今年の残りの期間を通じて、ドキュメント、スプレッドシート、スライドなどのアプリを、より柔軟、インタラクティブ、インテリジェントにするための機能強化が行われます。

主な機能

新しいインタラクティブな構築要素(スマートチップ、テンプレート、チェックリスト)は、ユーザー、コンテンツ、イベントをつないで 1 つのシームレスなエクスペリエンスを実現します。

名前リンクをドキュメント内で使うと、該当するユーザーの場所、肩書、連絡先情報などの詳細情報がスマートチップに表示されます。

チェックリストはウェブとモバイルで利用可能です。また、近日中に、チェックリストのアクション アイテムを他のユーザーに割り当てて、Google ToDo リストに表示できるようになります。

スプレッドシートのウェブ エクスペリエンスに分析支援機能がさらに追加され、数式の候補により、誰もがデータから分析情報を簡単に抽出できるようになります。

チームですでに作業している Google ドキュメント、Google スプレッドシート、スライドから直接、ウェブ上の Google Meet の通話にコンテンツを表示できます。

字幕のリアルタイム翻訳(5 言語対応)が Google Meet で利用可能になります。

ユーザーとコンテンツを表示するスペースが増え、コンテンツと動画フィードを固定または固定解除する機能など、Google Meet のエクスペリエンスをより細かく制御できるようになりました。また、会議疲れを考慮して、セルフフィードを完全にオフにする機能を追加しました。

統合

最近の AppSheet Automation の一般提供リリースにより、Google Workspace データソースを統合できるようになりました。今後は API の追加に取り組み、サードパーティのツールからの情報をスマートチップ、チェックリスト、テーブル テンプレートなどのスマート キャンバス要素に直接取り込めるようにしていきます。

Google Workspace のセキュリティ

管理者がセキュリティの脅威や悪用からユーザーや組織を保護するために必要な制御と機能を確実に利用できるようにするために、Google Workspace は新しい高度なセキュリティ機能を備えています。

アラート センター

Google Workspace のアラート センターは、ドメイン内のセキュリティ関連のアクティビティに関する実用的なリアルタイムのアラートとセキュリティの分析情報を提供します。そしてこのたび、アラート センターが VirusTotal の脅威コンテキストおよび評価データで強化されるようになりました。

重要なアラートは次のように 1 か所でまとめて表示されます。

セキュリティ侵害インジケーター: 他のアーティファクトとの脅威の関係を確認して、脅威への対策を計画し、不正なネットワーク インフラストラクチャを特定します。

脅威のグラフ: 脅威の関係をグラフで視覚化して、アラート確認の際に必要な情報の迅速かつ正確な把握を可能にします。

マルチアングル検出: YARA、SIGMA、侵入検知システムルールのクラウドソーシングを介して強化された評価情報を取得します。

Google Workspace リソースへのアクセスを制限する

管理者向けには Google Workspace リソースへのアクセスを制限する以下の機能強化をご用意しました。

管理者は、ユーザーや組織を悪用やセキュリティの脅威から保護するために、Google Workspace データへのアクセスを信頼するか、制限するか、ブロックするかを選択できます。新しいセキュリティ機能と研究プロジェクトの説明については、Google Cloud Security Talks をご覧ください。新しい Workspace セキュリティ バンドルの追加機能については、公式ブログ投稿をお読みください。

サステナビリティ

今年は Google のサステナビリティにとって大きな年でした。Google は、2007 年に大企業として初めてカーボン ニュートラルを達成し、2017 年以降、再生可能エネルギーで年間消費電力の 100% を賄うことに成功しています。そして今、Google は、2030 年までに 24 時間 365 日の消費電力を完全に脱炭素化するという新しい目標を掲げて、さらに進歩を目指しています。これを実現する一つの方法は、すでに利用可能なクリーン エネルギーを最大限に活用できるように、リアルタイムで運用を調整することです。

カーボン アウェア コンピューティング

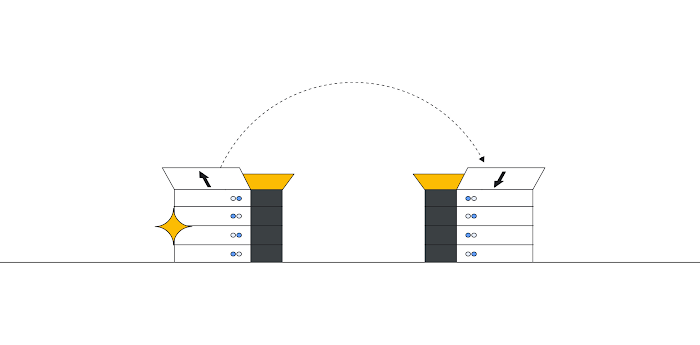

Google は、カーボン インテリジェント コンピューティングにおける最新のマイルストーンの達成により、地域の 1 時間あたりのカーボンフリー エネルギーの利用可能性に基づいて、移動可能なコンピューティング タスクを異なるデータセンター間でシフトできるようになりました。

コンピューティング タスクをさまざまな場所にシフトすることは、さまざまな時間にコンピューティングをシフトするというカーボンアウェア コンピューティングの第一歩をさらに推し進めたものです。データセンターが柔軟なタスクを 1 日のさまざまな時間にシフトできるようにすることで、太陽光や風力などのカーボンフリー エネルギー源が豊富なときに、より多くの電力を使用することができるようになりました。今では、より多くの電力消費をカーボンフリー エネルギーが利用可能な場所にシフトすることもできます。

仕組み

特定のデータセンターで使用されているコンピューティングの量は世界中で異なり、1 日を通して増減します。Google のカーボン インテリジェント プラットフォームは、特定のグリッドが炭素排出量の多いエネルギーにどれだけ大きく依存するかについての前日予測を行い、コンピューティングを世界中にシフトします。その際、カーボンフリーの電力が多い地域を優先します。

影響

Google のグローバルなカーボン インテリジェント コンピューティング プラットフォームは、YouTube のアップロード、フォト、ドライブなどのマルチメディア処理を始めとするコンピューティング ジョブについて、世界中で利用可能な最もクリーンなグリッド上で 1 時間あたりのコンピューティング容量を予約して使用する取り組みをますます進めています。

Google Cloud のデベロッパーは、よりクリーンなグリッドを優先し、カーボンフリー エネルギー(CFE)スコアに基づいて地域を選択することで、アプリに電力を供給するカーボンフリー エネルギーの割合を最大化できます。

詳細については、6 月 17 日午前 8 時(太平洋時間)に開催されるカーボン アウェア コンピューティング ワークショップのライブ配信をご覧ください。また、2030 年までに 24 時間 365 日カーボンフリー エネルギーを実現するための取り組みの詳細については、CEO である Sundar Pichai の最新のブログをご覧ください。

次世代の地熱テクノロジー

カーボンフリー エネルギーで 24 時間稼働するという目標を達成する一環として、今までに類を見ない次世代地熱発電プロジェクトを発表しました。「常時オン」のカーボンフリー リソースとして、まもなく、ラスベガスの Cloud リージョンを含む、ネバダ州全体のデータセンターとインフラストラクチャに電力を供給するグリッドへカーボンフリー エネルギーの投入を開始します。

Google は Fervo と提携して、再生可能エネルギー源としての次世代の地熱の生産性を高める AI と機械学習を開発しています。次世代の地熱は、高度な掘削、光ファイバー センシング、分析技術を使用することにより、まったく新しいクラスのリソースを最大限に活用できます。このパートナーシップにより、需要への対応がより効果的になると同時に、変動する再生可能エネルギー リソースによって生じたギャップを埋めることができます。

仕組み

Fervo は、坑井内の光ファイバー ケーブルを使用して、地熱資源の流れ、温度、パフォーマンスに関するリアルタイム データを収集できます。このデータにより、Fervo は最適な資源が存在する場所を正確に特定できるため、さまざまな深さで流れを制御できます。こうした機能は、AI および機械学習の開発と組み合わせることで、生産性を向上させ、さまざまな新しい場所で柔軟な地熱発電を最大限に活用できます。

影響

このプロジェクトは、ネバダ州のデータセンターと Cloud リージョンを 24 時間クリーン エネルギーに近づけ、次世代の地熱が、炭素を排出する化石燃料に取って代わることができる堅固で柔軟なカーボンフリー エネルギー源としての役割を果たすための準備を整えます。Google が Google Cloud リージョンのカーボンフリー エネルギーの割合を増やしていくことにより、ユーザーがこの進歩を直接活用して、組織のサステナビリティの目標を達成できるようになります。

以上は、Google I/O 2021 での Cloud の主な発表内容に過ぎません。Vertex AI を使用したデベロッパー中心の統合 ML エクスペリエンス、より柔軟で安全な多数の Workspace 機能、データセンターでのカーボンフリーの未来に向けた驚異的な進歩を中心に、エキサイティングなリリースを見てきました。ほかにも、AI とサーバーレスのデモダービー、Cloud Run でのフルスタック開発、機械学習を使用した日常問題の解決法に関するワークショップなど、重要な出来事がたくさんありましたので、オンデマンドで視聴することをおすすめします。詳細については、私のブログ投稿をご覧ください。セッション、AMA などへのアクセスについては、Google I/O サイトをご覧ください。

最新の Google Cloud のリリースについてご意見がございましたら、@stephr_wong で私とオンラインでつながり、お知らせください。

-デベロッパー アドボケイト Stephanie Wong